Du prompt à la production : sécuriser la nouvelle chaîne d’approvisionnement logicielle de l’IA

À l’ère de l’IA, les entreprises pourront concevoir des logiciels intelligents tout en garantissant un niveau de confiance et de gouvernance conforme aux exigences des grandes organisations

Lorsque Anthropic a annoncé les nouvelles capacités d’analyse de sécurité de Claude Code, à la suite de l’annonce d’Aardvark par OpenAI, cela a marqué un tournant important pour l’industrie. Pour la première fois, une revue de sécurité de niveau expert s’intègre directement au processus d’écriture du code. Les vulnérabilités subtiles et dépendantes du contexte peuvent désormais être signalées dès leur création. Il est possible de remédier aux failles avant qu’elles n’apparaissent dans un build.

Et cela ne s’arrêtera pas à l’Anthropic. Il faut s’attendre à des annonces similaires de la part d’autres fournisseurs d’IA, commerciaux ou open source. La détection des vulnérabilités et les mesures correctives au niveau du code deviendront largement accessibles. Avec le temps, il se pourrait même que cela se banalise.

La véritable question est ailleurs : si l’IA est capable de sécuriser le code avant sa compilation, quels risques subsistent encore ?

La disparition silencieuse du code

Dans l’approche traditionnelle du développement logiciel, tout gravitait autour du code source. C’était l’élément que les équipes examinaient, testaient, sécurisaient et sur lequel elles travaillaient ensemble.

Mais un changement subtil est en train de s’opérer : le code n’est plus le produit final. Il devient une étape intermédiaire.

Le véritable résultat, celui qui est expédié, déployé et exécuté : l’artefact binaire. Une image de conteneur. Un package. Une bibliothèque. Une version compilée.

Une part considérable de ce qui façonne réellement le comportement, la posture de sécurité, les performances et la conformité d’une release ne provient pas du tout de l’équipe de développement, ni même de votre agent de codage. Dans les logiciels modernes, la majorité des éléments intégrés dans un produit livré proviennent d’ailleurs :

- Dépendances open source ;

- Packages tiers ;

- Bibliothèques internes développées par l’organisation ;

- Bibliothèques transitives profondes résolues par les gestionnaires de packages ;

- Systèmes de build, compilateurs et extensions pour développeurs

- Et désormais, d’artefacts d’IA, tels que des compétences, des agents, des plugins et des serveurs MCP.

L’application ne se résume désormais plus à une base de code. Il s’agit d’une chaîne d’approvisionnement assemblée.

Le centre de gravité s’est déplacé : du code source à l’artefact qui intègre tout ce qui l’entoure.

Ainsi, si l’IA rend le code source plus propre, la version publiée, elle, devient plus complexe. Cette complexité entraîne également un déplacement des risques.

Même lorsque le code est parfait, la version est toujours vulnérable

Imaginez un futur proche où le code généré par l’IA est presque parfait.

Il se compile proprement. Il passe l’analyse statique. Il remédie automatiquement aux vulnérabilités avant même que vous ne les remarquiez.

Du point de vue de la source, tout semble sain.

Mais une fois que votre code est compilé, la version ne consiste plus seulement en ce que votre équipe ou l’IA a écrit. Il comprend des dizaines, voire des centaines, de binaires de tiers. L’un d’entre eux peut être porteur d’une vulnérabilité nouvellement divulguée. Un autre peut contenir un code malveillant délibérément conçu pour échapper à la détection.

Dans des scénarios plus avancés, les acteurs malveillants peuvent même utiliser l’IA pour créer des workloads conçues spécifiquement pour contourner les systèmes d’inspection basés sur l’IA. Ce qui protège peut aussi attaquer. La même technologie peut être transformée en outil offensif, capable de générer du code obfusqué, des triggers intelligents dépendants du contexte ou des portes dérobées latentes parfaitement intégrées à des schémas applicatifs légitimes.

Et du jour au lendemain, c’est l’ensemble de la production qui est exposé.

Le code généré ne présentait aucune anomalie. Le problème réside dans une dépendance que vous n’avez pas écrite.

C’est précisément ce qui s’est produit lors du récent incident React2Shell, et auparavant avec Log4Shell. Ce n’est pas une défaillance du processus de revue de code qui a mis les équipes de production sous pression. Si elles étaient sous pression, c’est parce qu’elles ignoraient quelles releases en production contenaient le binaire vulnérable.

Le défi n’était pas la qualité du code. L’enjeu résidait dans la visibilité des artefacts binaires.

L’incident Log4Shell a mis en évidence l’importance des SBOM : vous devez avoir une visibilité précise sur les composants intégrés à chaque release. Identifier la présence d’une vulnérabilité n’est qu’une première étape. Encore faut-il établir si elle est réellement accessible et activable dans le binaire.

De nos jours, il s’agit également d’une obligation légale. En vertu de réglementations telles que la loi sur la cyberrésilience (CRA), les organisations doivent assurer le suivi des logiciels qu’elles diffusent et signaler sans délai les vulnérabilités connues. Si vous ne pouvez pas identifier immédiatement les versions affectées et en évaluer l’exploitabilité, vous êtes exposé tant techniquement que juridiquement.

Dans un monde dominé par l’IA, le frein principal ne réside pas dans la rédaction d’un code sûr. Le véritable défi consiste à maîtriser précisément ce que vous avez mis en production.

Deux mondes de la défense

L’annonce d’Anthropic solidifie une couche clé de la chaîne de sécurité : la défense directement intégrée au code.

Cette couche vise à prévenir les vulnérabilités au moment de la création. Elle est proactive, contextuelle et de plus en plus assistée par l’IA.

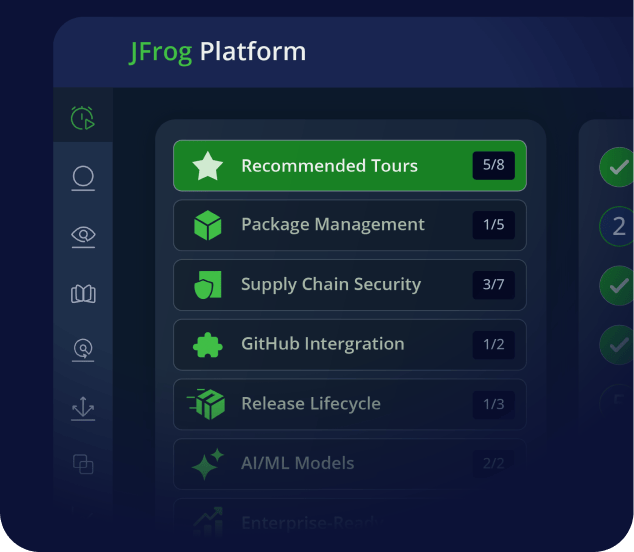

Une autre couche, qui coexiste avec la sécurité du code source, est la gouvernance au niveau des binaires. Elle fait office à la fois de source de vérité unique et de gardien de la chaîne d’approvisionnement logicielle. C’est dans ce domaine que JFrog joue un rôle de premier plan et fournit une infrastructure complémentaire.

Une fois compilé, empaqueté et distribué, le code change de nature. Il devient un artefact qui circule entre les dépôts, les pipelines, les postes de travail et les clusters de production.

À ce stade, la sécurité ne consiste plus à examiner des lignes de code ou à effectuer des scans. Il s’agit d’un problème de plan de contrôle.

Il s’agit de répondre à des questions telles que :

- Qu’est-ce qui est exactement entré dans mon organisation ?

- Qu’est-ce qui est inclus dans chaque release ?

- Qu’est-ce qui est actuellement en cours de production ?

- Puis-je le tracer, l’auditer et y remédier à grande échelle ?

- Puis-je prouver que je respecte les exigences réglementaires ?

Pourquoi l’IA seule ne suffit pas à assurer la gouvernance des entreprises ?

L’IA est remarquablement puissante lorsqu’il s’agit de raisonner sur le texte et la logique. Mais la gouvernance n’est pas une question d’inférence. Il s’agit de contrôle.

Il s’agit de responsabilités fondamentalement différentes. Et une véritable gouvernance nécessite un système d’enregistrement faisant autorité.

L’IA seule ne peut pas :

- Agir en tant que source unique et immuable de vérité ;

- Appliquer des politiques de promotion dans tous les environnements ;

- Empêcher les binaires dangereux d’entrer dans une organisation ;

- Maintenir des métadonnées d’artefacts faisant autorité ;

- Enregistrer des journaux de promotion servant de pistes d’audit ;

- Garantir les attestations de provenance ;

- Servir de système réglementaire de preuves.

L’IA peut conseiller, analyser et même générer, mais seul un système d’enregistrement gouverné peut appliquer les règles, contrôler et apporter des preuves.

La nécessité d’une source de vérité unique faisant office de gardien

Pour le code source, les plateformes Git servent de système d’enregistrement. Dans un monde qui se rapproche d’un code entièrement généré par l’IA, les fondements de la collaboration orientée Git évoluent discrètement.

Quel est l’équivalent pour les fichiers binaires ?

Les entreprises ont besoin de plus qu’un simple stockage évolutif. Elles ont besoin d’une source de vérité unique et active, un véritable gardien qui contrôle ce qui entre dans l’organisation et influence directement ce qui est mis en production.

Un système d’enregistrement de binaires actif doit fonctionner comme un plan de contrôle qui applique des politiques et qui régit :

- Toute dépendance entrant dans l’organisation ;

- Chaque artefact de build qui est stocké et distribué ;

- Chaque version déployée dans les environnements d’exécution ;

- Toutes les mesures correctives requises après la divulgation de nouvelles vulnérabilités.

Mais il est important de noter que ce contrôle ne commence pas au moment de la mise en production. Il commence au moment de l’installation.

La menace ne se limite pas à ce que vous livrez

Pour de nombreux binaires malveillants, la question n’est pas seulement de savoir s’ils sont intégrés dans une version.

Ils ciblent directement le développeur dès qu’ils sont installés sur son ordinateur.

Voici quelques exemples :

- Les logiciels malveillants de la supply chain, à l’image du ver npm Shai Hulud, dont l’exécution se déclenche dès la phase d’installation ;

- Les extensions d’IA malveillantes ou écosystèmes de plugins ;

- Les compétences OpenClaw compromises qui exécutent les prérequis localement lors de leur récupération.

Dans ces scénarios, le poste du développeur devient la première surface d’exposition.

C’est pourquoi un système d’enregistrement actif doit être à même de :

- Bloquer les binaires non fiables avant qu’ils ne soient téléchargés dans l’entreprise

- Appliquer les politiques avant toute installation ;

- Valider la provenance, l’intégrité et les signatures ;

- Appliquer les contrôles de sécurité et les contrôles des risques de l’entreprise : règles de licence, d’exportation et de conformité interne ;

- Réévaluer en continu les artefacts stockés à mesure que de nouvelles informations deviennent disponibles.

Il ne doit pas seulement s’agir d’un dépôt d’artefacts sécurisé. Un tel système doit être un moteur de gouvernance et de contrôle des risques pour l’entreprise ; un gatekeeper qui décide en continu de ce qui peut pénétrer, circuler et se maintenir dans votre environnement. Une plateforme qui devient la seule source de vérité.

L’IA change la création et la gouvernance doit suivre

Les promesses de l’IA dans le domaine du développement sont extraordinaires. Elle réduit les frictions, accélère l’itération et démocratise l’expertise.

L’IA modifie également la vitesse et la portée des risques.

Lorsque les logiciels peuvent être générés à grande échelle, le tsunami de binaires entrant dans votre organisation croît tout aussi rapidement. Les dépendances, les outils, les plugins, les composants générés par l’IA se multiplient.

La sécurité ne peut se limiter à l’examen de ce qui est écrit. Elle doit régir ce qui existe.

C’est ici que la plateforme de chaîne d’approvisionnement logicielle de JFrog joue un rôle essentiel en tant que couche de contrôle et référentiel central. Elle propose un ensemble de capacités de sécurité centrées sur les binaires, permettant d’assurer la gouvernance, l’application des politiques et une visibilité de bout en bout sur l’ensemble de la chaîne d’approvisionnement logicielle.

L’IA renforce ce qui est créé. JFrog régit ce qui est téléchargé, buildé, stocké, distribué, exécuté et publié.

Ensemble, ils créent un cycle de vie sécurisé, du prompt à la production.